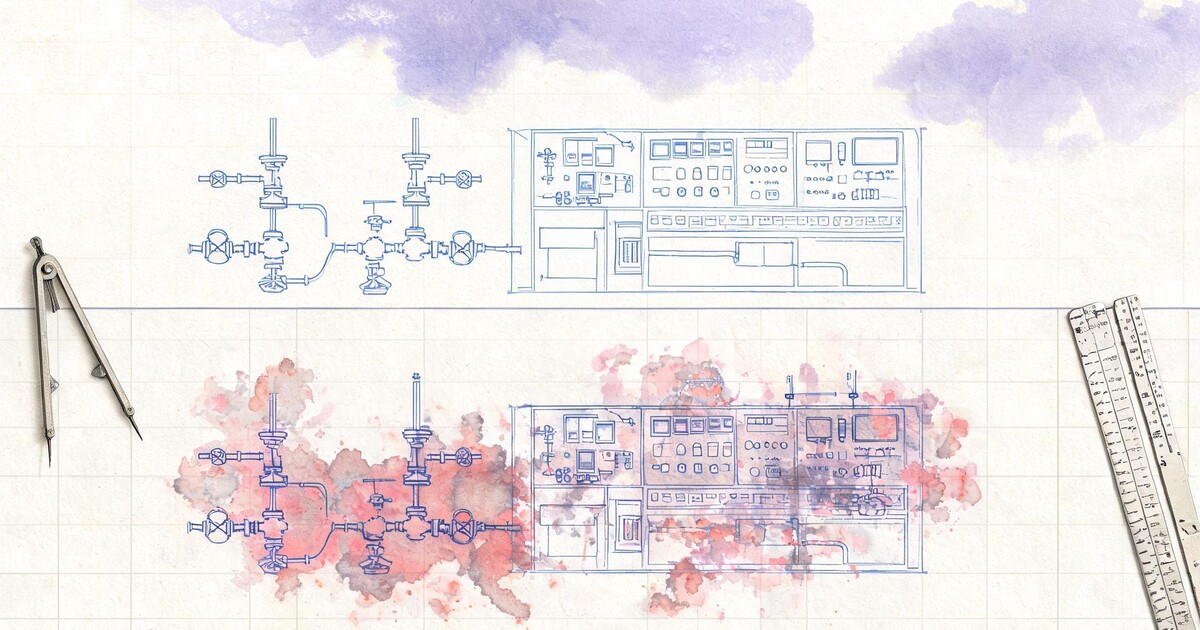

3月31日凌晨,安全研究员Chaofan Shou在npm注册表里发现了一个59.8MB的文件——cli.js.map。这个本不该出现在生产包里的source map文件,指向了Anthropic Cloudflare R2存储桶上的一个压缩包。解压后,1900个TypeScript文件、512,000+行代码赫然在目。Claude Code——这个年化收入已达25亿美元的AI编程工具——把自己的全部源码暴露在了公网上。

这不是一次黑客攻击,而是一次构建配置失误。更讽刺的是,这已经是五周内第二次同样的泄漏。

1900个

TypeScript源文件

512K行

源代码总量

44个

隐藏Feature Flag

泄漏原因:Bun的source map陷阱

Claude Code使用Bun运行时构建(Anthropic于2025年底收购了Bun)。Bun的打包器默认生成source map,除非显式禁用。问题出在没有人将*.map加入.npmignore,也没有配置打包器跳过source map生成。

更深层的问题是:早在3月11日,Bun就有一个已知bug——即使文档声称生产模式下不生成source map,实际上仍会生成。Anthropic自己的工具链,发布了自己已知存在的bug。

这是一个典型的DevOps安全事故。对于任何使用CI/CD自动发布npm包的企业来说,这是一面镜子:你的构建产物里,有多少不该出现的文件?

23道安全检查:Bash执行的工业级防线

泄漏代码中最值得关注的是bashSecurity.ts。每一条Bash命令在执行前都要经过23道编号的安全检查,包括:

- 18个被封禁的Zsh内建命令

- 命令注入检测(防止

$()和反引号攻击) - 路径遍历检测

- 敏感文件访问拦截(

.env、credentials等) - 沙箱逃逸防护

这揭示了一个关键洞察:AI Agent的安全性不在模型层面,而在工程层面。 模型本身无法阻止自己执行危险命令——安全完全依赖于外围的检查机制。这与传统软件安全的纵深防御理念一致:不要信任任何单一层面的防护。

对于正在部署AI Agent的企业,这意味着:即使使用了最安全的大模型,如果没有在Agent执行层建立类似的多层检查机制,系统仍然是脆弱的。

KAIROS:永不停歇的AI守护进程

泄漏代码中出现了150+次的关键词——KAIROS。这是一个自治守护进程模式,允许Claude Code作为后台Agent持续运行。

最令人震撼的是其中的/dream技能和autoDream机制:在空闲时段(类似夜间),Agent会自动进行记忆蒸馏——合并观察记录、消除矛盾信息、将洞察转化为事实。这本质上是一个持续学习的Agent操作系统。

auto_awesomeKAIROS架构的企业意义

KAIROS代表了AI Agent的下一个形态:从被动的工具调用,到主动的后台自治。想象一个7x24小时运行的AI Agent,持续监控生产系统、自动修复异常、在夜间整理和优化知识库。这不再是科幻——Claude Code的源码证明,这个架构已经在生产中运行。对于制造业企业来说,这意味着AI Agent可以像值班工程师一样持续工作,而不是等着被人调用。

反蒸馏投毒:AI公司的攻防暗战

泄漏中最具争议的发现之一是ANTI_DISTILLATION_CC机制。当此标志启用时,Claude Code会向系统提示词中注入虚假的工具定义,目的是:如果有人录制API通信来训练竞品模型,获得的训练数据会被污染。

这不是理论上的防护——这是实际部署的生产代码。它揭示了AI公司之间围绕模型蒸馏的攻防已经进入了实战阶段。

同样引发争议的是Undercover Mode——Anthropic使用Claude Code向公共开源仓库进行隐蔽贡献,系统提示词明确警告:不得在commit信息中包含任何Anthropic内部信息,不能暴露身份。

这些发现引发了关于AI公司伦理边界的广泛讨论。但从技术角度看,它们也揭示了一个现实:AI产品的竞争不仅是模型能力的竞争,更是工程体系和商业策略的全面较量。

真正的护城河:不是模型,是系统

Sebastian Raschka在分析中一针见血地指出:Claude Code的真正秘密武器不是模型本身。大量的性能优势来自围绕模型构建的工程系统:

- 四阶段上下文管理流水线:从原始对话到压缩、缓存、检索的全链路管理

- 多层记忆系统:会话级、项目级、长期记忆的三层架构

- 提示缓存经济学:

promptCacheBreakDetection.ts追踪14种缓存失效向量,使用粘性锁存器防止模式切换导致缓存失效——这直接影响API调用成本 - 多Agent编排:AgentTool系统支持协调者模式,让单个Agent生成并管理并行工作Agent

- 插件架构:内建和第三方插件的完整生态

供应链安全的连锁反应

泄漏发生的同时,npm生态还遭遇了另一起攻击:axios包(版本1.14.1和0.30.4)被植入远程访问木马。在3月31日00:21至03:29 UTC之间通过npm安装或更新Claude Code的用户,可能同时拉取了恶意的axios版本。

这形成了一个完美风暴:源码泄漏+供应链投毒,同时发生在同一个工具上。对于企业用户来说,这是一个严肃的提醒:

- 锁定依赖版本——永远不要在生产环境使用

latest - 使用私有npm镜像——隔离公网包注册表的风险

- 建立SBOM(软件物料清单)——知道你的系统里跑着什么

企业AI Agent安全:从Claude Code学到什么

这次泄漏为所有正在部署AI Agent的企业提供了一份免费的安全架构参考:

| 安全维度 | Claude Code的做法 | 企业应该学的 |

|---|---|---|

| 命令执行 | 23道Bash安全检查 | 对Agent的每个工具调用建立白名单和审计日志 |

| 权限管理 | 分级权限模型+远程开关 | 最小权限原则+人工审批关键操作 |

| 上下文安全 | 四阶段管道+注入检测 | 验证所有外部输入,防止提示注入 |

| 供应链 | 依赖Bun生态 | 锁定版本+私有镜像+SBOM审计 |

| 数据防护 | 反蒸馏机制 | API调用加密+访问日志+异常检测 |

写在最后:透明与安全的平衡

Anthropic的官方回应称这是一次打包配置错误,不涉及客户数据泄漏。但五周内两次相同的失误,加上同期CMS配置错误暴露未发布模型细节,说明即使是最前沿的AI公司,在基础的DevSecOps实践上也存在盲区。

对于企业决策者来说,这次事件的核心启示不是Claude Code不安全——恰恰相反,泄漏的源码展示了极其严格的安全工程实践。真正的教训是:AI系统的安全性取决于整个工程体系的成熟度,而不仅仅是模型本身。

无论你选择什么大模型,都需要在其外围构建完整的安全防护、权限管理、审计追踪和应急响应能力。这正是FluxWise智流科技在帮助企业部署AI Agent时始终坚持的原则:安全不是事后补丁,而是架构设计的第一优先级。