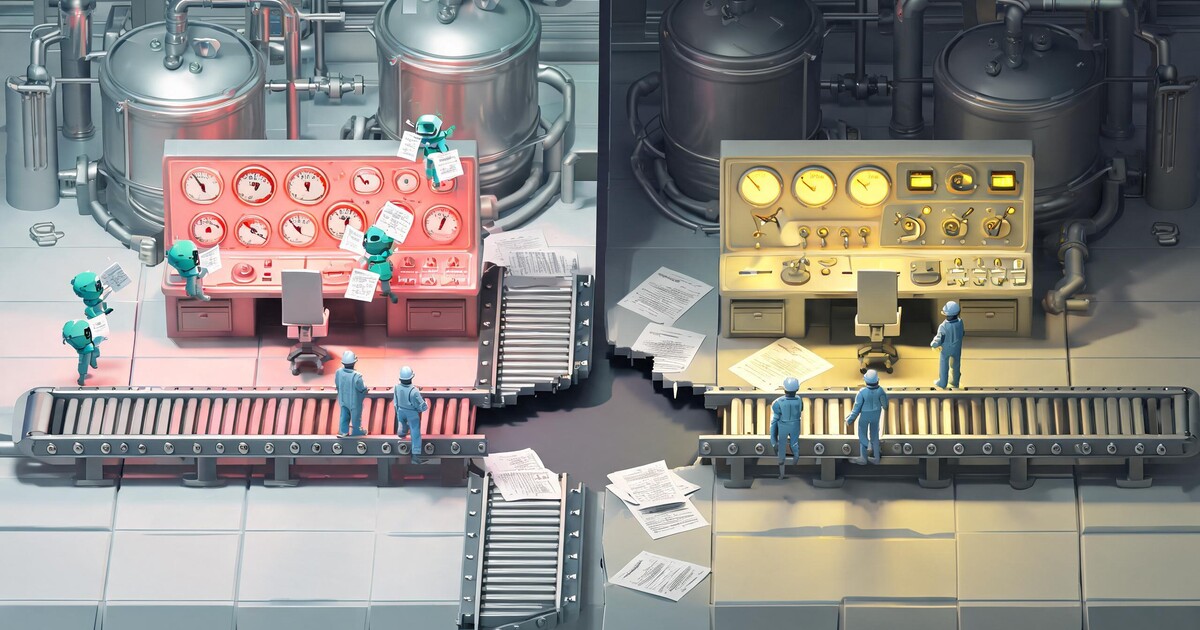

当AI在实验室达到98%准确率的那一刻,往往就是它开始在产线杀人的倒计时。某头部锂电材料集团2026年Q1的财报显示,他们引以为傲的配方优化系统上线半年,非但没有提升良品率,反而让批次报废成本增加了2300万——因为算法在数字孪生里学会的完美配方,在真实的工艺漂移面前像个高度近视的质检员。

98%

实验室配方优化准确率

83%

产线实际良品率(暴跌15%)

8秒

LangGraph State同步延迟导致废品产生

这不是数据标注错误或模型训练不足的问题。我们在复盘时发现,该集团使用的LangGraph v0.4.2(78K stars)在编排多步骤配方Agent时,其State Management机制默认采用批处理模式,而产线DCS系统的温度传感器每200ms就推送一次数据。当烧结炉出现3℃的微幅漂移时,Agent需要整整8秒才能完成从数据摄入、状态更新到执行决策的完整图遍历——此时炉内已完成两个失效相变周期。

为什么实验室之神到了产线就成了瞎子?

大多数CTO在验收AI项目时犯了一个致命错误:他们把实验室闭环等同于产线就绪。该锂电集团的技术栈很典型:基于DSPy v3.1.0(22K stars)构建的预测模型,在离线数据集上通过Few-shot优化达到了惊人的拟合度,配合Llama 4-70B的推理能力,能够精准预测NCM正极材料在特定温度曲线下的晶体结构缺陷。

然而DSPy的声明式优化有个隐蔽的陷阱——它在封闭域(实验室固定设备、单一原料批次)内的优化能力越强,向开放域(真实产线的设备老化、原料波动、环境温湿度变化)迁移时的过拟合幻觉就越严重。该集团的AI在实验室学会了识别完美的前驱体粒径分布,但当供应商更换了研磨工艺导致粒径中位数偏移0.5μm时,模型输出的烧结温度修正值反而加剧了晶格畸变。

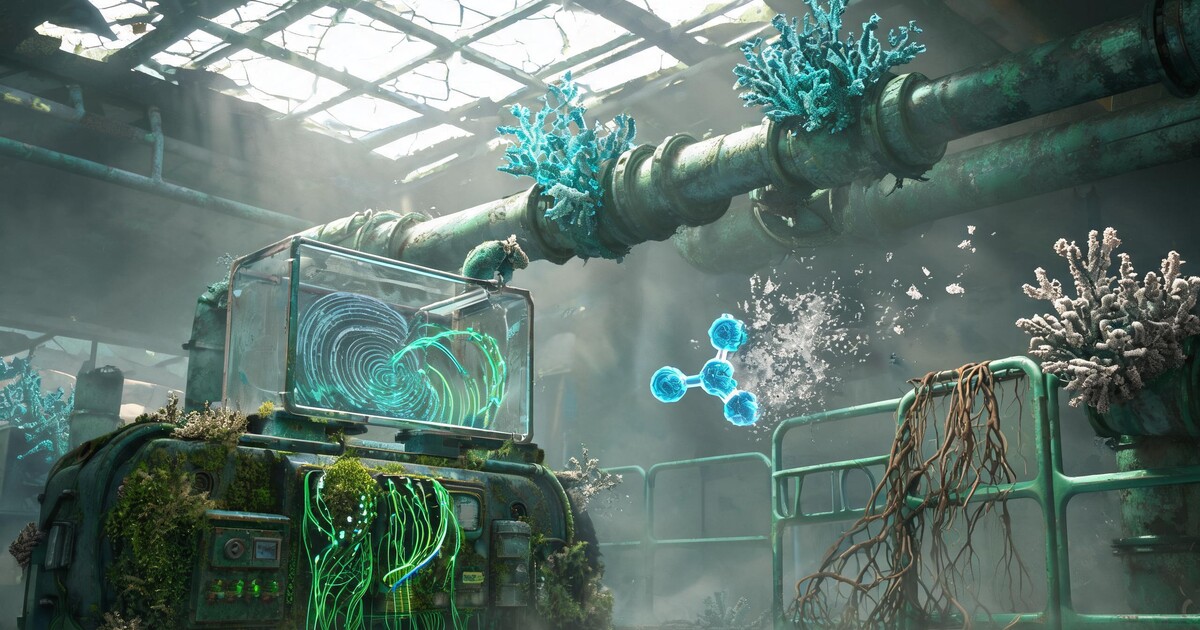

MCP v2协议:实时接入的救世主还是新陷阱?

2026年3月发布的MCP(Model Context Protocol)v2.0协议被业界寄予厚望,它标准化了AI Agent与外部工具、数据源的双向通信机制。理论上,通过MCP Server接入DCS(分布式控制系统),配方Agent应该能实时获取炉温、氧含量、压力等OT数据。

但在该集团的实施中,我们发现了MCP v2规范中一个被忽视的隐性成本:时钟同步精度。当MCP Client(运行在IT层的LangGraph Agent)通过MQTT over 5G从DCS获取数据时,虽然单次延迟控制在50ms以内,但MCP协议栈的JSON序列化/反序列化、权限校验、上下文组装累计产生了120-200ms的额外开销。更致命的是,MCP v2默认的异步回调机制与DCS的实时控制回路(通常要求<100ms响应)存在架构级错配。

我们在FluxWise智流科技的产线测试中发现,当MCP Server与DCS的时钟偏差超过50ms时,配方Agent会基于过时状态做出决策。想象一下:AI看到的数据是8:00:00.050的炉温,但实际物理时间已经是8:00:00.200,而它在8:00:00.150时就已经错过了最佳的氮气注入窗口。这种微观层面的时空错乱,在宏观上表现为整批材料的化学计量比失控。

auto_awesome工艺漂移的蝴蝶效应

锂电正极材料的烧结过程涉及15-20个耦合变量。当 LangGraph 的图节点在计算最优升温速率时,产线的电压波动可能已经改变了加热元件的实际功率输出。没有亚秒级闭环控制能力的AI,本质上是在开环驾驶一辆时速200公里的赛车——而且后视镜还有8秒延迟。

冷启动-热失控悖论:数据越多,死得越快

该集团的AI项目还揭示了一个反直觉现象:我们称之为配方AI的冷启动-热失控悖论。在系统上线初期,基于有限历史数据训练的轻量级模型(使用DSPy的Bootstrap Few-shot)虽然准确率只有85%,但产线良品率维持在94%。随着系统收集到越来越多的实验室数据,团队不断用新数据微调模型,准确率飙升至98%,产线良品率却断崖式下跌至83%。

根源在于数据分布的坍塌。实验室为了快速验证,倾向于使用理想状态下的原料(杂质含量低、粒径分布窄、湿度恒定),而产线面对的是连续生产的现实波动。当AI在大量实验室纯净数据上强化学习时,它实际上是在构建一个对现实世界过度敏感的脆弱系统——就像用无菌室培养的细菌去对抗复杂的生态系统。

LangGraph v0.4虽然引入了Streaming Mode试图解决实时性问题,但其底层的Pregel图计算引擎仍然基于批次(batch)的checkpoint机制。在配方优化场景中,这意味着当Agent正在执行第5步(调整氧气流量)时,第3步(修正升温曲线)的输入数据已经因为设备老化而产生了物理偏移,但State Graph仍基于旧的假设继续执行。

破局之路:从预测Agent到反射式控制

解决死亡迁移不能靠更换更大的模型(GPT-5或Claude 4 Opus在这方面并无本质差异),而必须重构AI与物理世界的接口架构。

边缘原生Agent架构

将LangGraph的逻辑拆解为边缘侧的微Agent(Micro-Agent),直接在DCS控制器旁部署,将决策延迟压缩到50ms以内。放弃全量State Graph的强一致性,采用最终一致性模型,允许局部决策基于 slightly stale 数据快速执行,而非等待全局状态同步。

MCP over TSN(时间敏感网络)

针对MCP v2协议的时钟同步问题,采用IEEE 802.1AS时间同步标准,在OT层部署硬件级时间戳。将MCP的JSON负载替换为Protobuf二进制格式,削减序列化开销。FluxWise的实践表明,这能将端到端延迟从200ms降至30ms以内,满足烧结炉的实时控制需求。

域随机化训练(Domain Randomization)

在DSPy v3的优化流程中引入对抗性数据增强:在训练阶段就向输入数据注入模拟的设备老化噪声、原料批次方差和传感器漂移。让AI在数字孪生中经历比现实更残酷的环境,反而能提升产线鲁棒性。某光伏材料客户采用此方案后,配方迁移的良品率损失从15%降至3%。

回到那个锂电集团案例。在重构架构后——将DSPy模型蒸馏为边缘可运行的TinyLLM,通过MCP over TSN接入DCS,并采用异步Checkpoint机制——他们的配方Agent终于跟上了产线的物理节拍。上线三个月后,良品率回升至96%,且能自动适应原料批次的微观波动。

这场价值2300万的教训告诉我们:企业AI的瓶颈从来不是算法精度,而是工程化的时空观。当CTO们在评估AI项目时,应该少问准确率达到了几个9,多问一句:当物理世界发生变化时,你的Agent能在多少毫秒内做出反应?在这个维度上,98%的准确率不如83%的准确率加上8毫秒的延迟——因为产线不等你推理,它一直在燃烧。