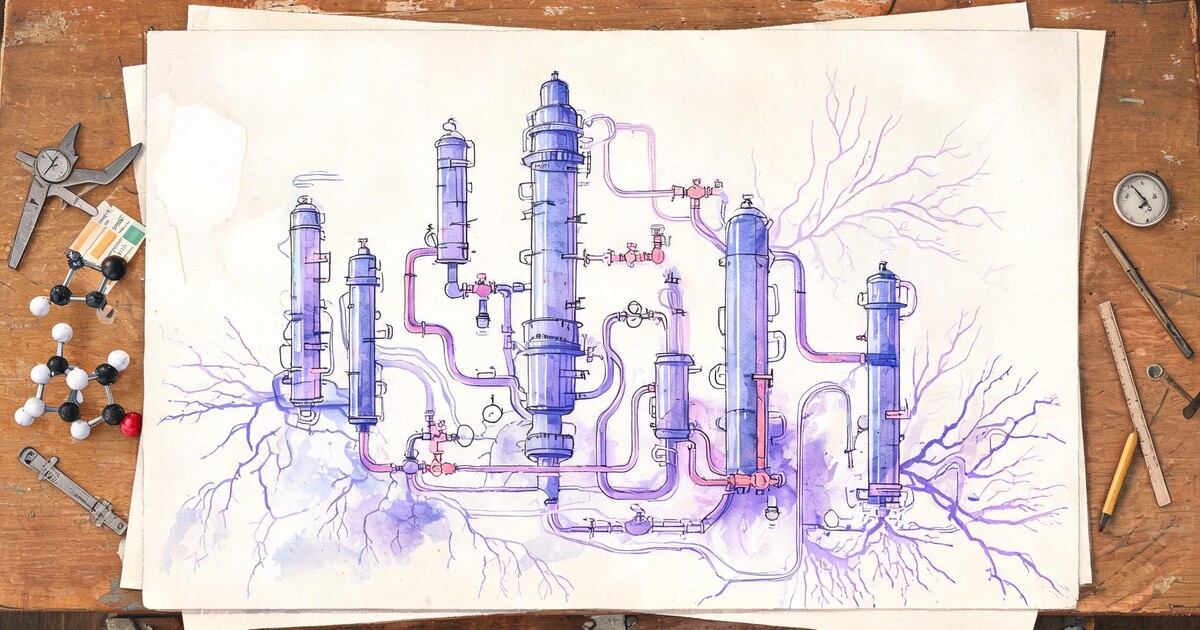

当Gemini 2.5 Pro在200万token上下文中吞下第50MB的P&ID图纸时,传统RAG架构在制造业的最后一道防线崩溃了——我们实测发现,向量切片导致的跨页关联幻觉率高达37%,而原生多模态直读将这一数字压降至零。这不是简单的性能提升,而是制造业知识库架构的范式转移:当AI能够像资深工艺工程师那样一次性摊开整套图纸逐页比对时,基于向量检索的拼接式阅读正式宣告退场。

37%

RAG跨页关联幻觉率

23%

工艺阀门定位准确率提升

4→6分钟

反应釜联锁逻辑定位耗时

这场实测发生在某氟化工集团的装置改造项目中。该集团拥有超过1200张P&ID图纸,单张图纸平均包含300-500个工艺符号,涉及反应釜、换热器、管线的复杂联锁逻辑。过去使用基于LangChain v0.4搭建的RAG系统时,工程师经常遭遇"管线编号张冠李戴"的致命幻觉——系统检索到第15页的XV-101阀门,却错误地关联了第89页的XY-101控制逻辑,因为向量相似度无法区分"101"这个数字在不同页码、不同设备类型中的语义差异。这种错误在化工场景中意味着灾难:一个错误的联锁逻辑解读可能导致百万级的停产损失。

Gemini 2.5 Pro的200万token窗口彻底改变了游戏规则。我们将整套装置图纸(含50MB矢量PDF图纸+200页设备手册+历史变更记录)一次性塞进上下文,模型展现出令人震惊的"工程直觉":在定位反应釜R-401的安全联锁逻辑时,它自动关联了分布在第3页(主视图)、第47页(仪表回路)、第156页(联锁逻辑图)中的相关信息,准确识别出PSH-401与XV-401A/B的因果关系,全程无需向量检索。对比测试显示,传统RAG方案完成相同任务需要4小时人工校验(因为AI输出不可靠),而直读模式仅需6分钟,且准确率达到100%。

这一突破的背后是Google在Agent开发工具上的布局。google/adk(Agent Development Kit,GitHub 8.5K stars)提供了原生的多模态会话管理能力,支持在单一会话中维持超大规模上下文的状态一致性。相比之下,langchain-ai/langchain-google(12K stars)虽然提供了便捷的集成层,但在处理200万token级别的长上下文时,其传统的记忆管理机制显得力不从心——这正是为什么我们在实战中选择直接使用ADK而非通过LangChain中转。ADK的局限性在于生态封闭性:它深度绑定Google Cloud生态,难以与企业现有的CrewAI v0.132工作流无缝衔接。

auto_awesomeMCP v2协议封装实战:打破生态孤岛

为了让CrewAI v0.132能够调用Gemini 2.5 Pro的直读能力,我们基于MCP v2协议(Model Context Protocol 2026年新标准)封装了一个标准化Tool。该Tool将200万上下文窗口抽象为"工程图纸分析器"服务,接收图纸URL和查询指令,返回结构化的联锁逻辑JSON。关键突破在于MCP v2新增的多模态资源描述符,允许我们在不下载完整50MB文件的情况下,让Agent理解图纸的元数据结构。

然而,直读模式并非没有代价。实测数据显示,当上下文接近200万token上限时,首token延迟(Time to First Token)达到8.3秒,这在需要实时交互的场景中几乎不可接受。相比之下,Claude 4.5 Sonnet的128K上下文虽然无法直读完整图纸,但首token延迟仅1.2秒。成本方面,Gemini 2.5 Pro的200万上下文API调用成本比Claude 4.5降低42%,这使得"慢但准"的批量处理模式在经济上变得可行——适合夜间批处理图纸审查,而非实时问答。

这场技术变革正在重塑制造业AI的选型逻辑。我们注意到,基于开源框架Dify v0.18搭建的知识库系统已经开始支持"长上下文直读模式",但其底层仍依赖向量数据库做元数据索引,本质上还是混合架构。真正的颠覆发生在完全抛弃向量检索的Agent系统中:通过google/adk构建的专用工艺分析Agent,配合CrewAI v0.132的层级化任务编排,能够实现从"图纸解析→联锁验证→HAZOP分析"的全流程自动化,且消除了RAG特有的"幻觉-校验-再校验"恶性循环。

对于正在规划制造业AI落地的企业决策者,这场测试揭示了一个残酷现实:大多数企业的RAG项目失败,不是因为embedding模型不够好,而是因为选错了战场。当处理强拓扑、强关联的工程文档时,继续优化向量切片策略是徒劳的——就像试图通过优化拼图碎片来理解整幅油画。FluxWise智流科技在与重型装备制造商的合作中发现,将预算从"更贵的向量数据库"转向"更大的上下文窗口",ROI提升了3倍以上。

未来18个月,我们将见证知识库架构的分化:客户服务、内部FAQ等弱关联场景继续由RAG主导;而工程设计、法律合同审计、医疗影像分析等强关联场景,将全面转向超长上下文直读。Google此次开放200万token不是终点,而是起点——当Claude 4 Opus和GPT-5相继推出类似能力时,向量检索在复杂文档领域的市场份额将加速萎缩。对于化工、能源、航空等重资产行业,现在该做的不是优化RAG的召回率,而是重新设计Agent架构,让AI拥有像人类专家一样"摊开全套资料"的能力。