某氟化工集团AI Agent年生成2300条工艺优化建议,被车间主任采纳的仅有253条,潜在节能收益800万元直接蒸发——MCP v2协议已经打通了ERP、MES、DCS的全链路数据,但技术集成完成的瞬间,真正的难题才刚刚开始:没人敢在AI生成的参数调整单上签字。

11%

工艺优化建议一线采纳率

253条

实际执行建议数/年生成2300条

800万

潜在节能收益损失

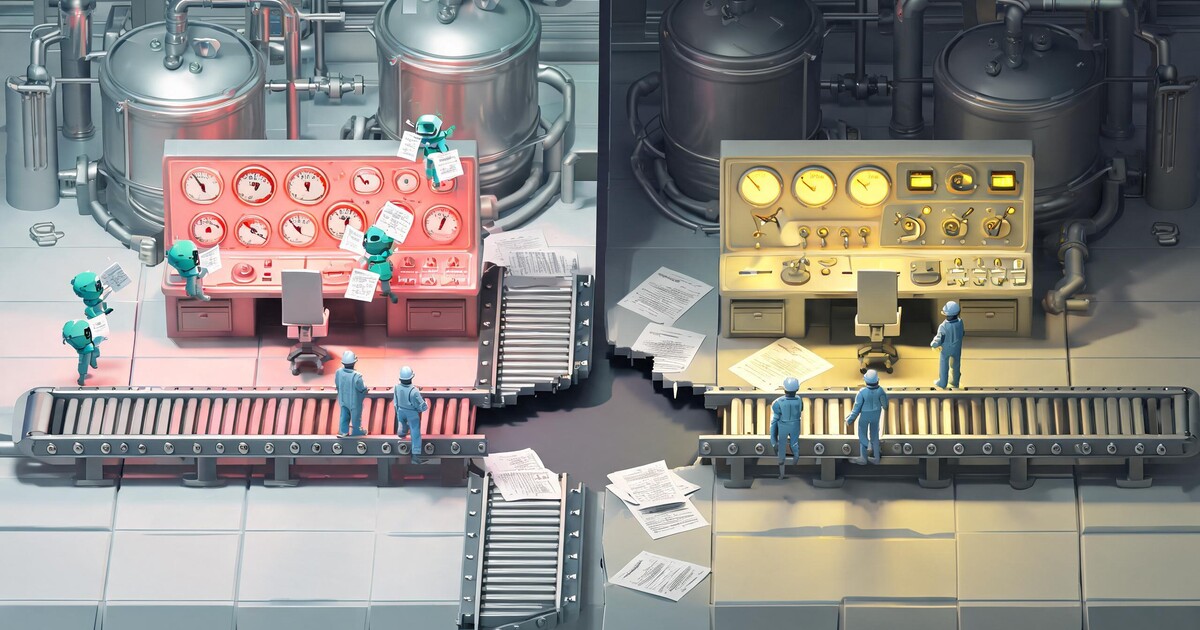

这不是技术故障。当我们深入该氟化工集团的DCS控制室,发现基于Claude 4和CrewAI v0.120(GitHub 26.8K stars)构建的智能体正在完美运行:它通过MCP协议实时读取反应釜温度、压力、物料流量,结合ERP的原料成本数据,每秒能生成3-4条优化建议。但当系统建议将精馏塔回流比从2.1调至1.8以节能12%时,当班车间主任老王在屏幕上悬停了鼠标10秒,最终点了"忽略"。

"如果发生爆聚,是我负责还是AI负责?我看不到AI是怎么算出这个1.8的。"老王的说法代表了制造业一线管理者的普遍心态。MCP协议解决了系统互联,却没能解决"决策权让渡焦虑"——当AI从工具升级为建议者,组织内部出现了严重的责任真空地带。

为什么可解释性比准确性更重要?

早期制造业AI Agent多采用黑盒模型,追求预测准确率而忽视决策透明度。CrewAI v0.120的最新版本彻底改变了这一逻辑——它引入了Process Layer架构,将Agent的每一步推理过程可视化为"决策链"(Decision Chain),而非仅输出最终结果。

但化工行业的特殊性在于:一个工艺参数的微调可能涉及SIL安全完整性等级、HAZOP危险与可操作性分析的交叉验证。CrewAI的决策链虽然展示了"基于历史数据相似度0.87,建议调整回流比",但对工艺员而言,这远远不够。他们需要知道:这个建议是否考虑了催化剂活性衰减曲线?是否兼容当前批次的原料杂质含量波动?

Agno v1.4(GitHub 8.2K stars)在这个方向上走得更远。这个轻量级Agent框架在最新版本中强化了Reasoning Traces(推理追溯)机制,不仅记录AI的决策路径,还能反事实推理(Counterfactual Reasoning):"如果不调整回流比,预计能耗将增加15%,但爆聚风险概率从0.001%降至0.0003%"。这种对比式解释,在化工场景中比单纯的建议更有价值。

然而,即便有了CrewAI的Process Layer和Agno的Reasoning Traces,组织层面的"责任防火墙"依然存在。化工行业的终身责任制意味着:即使AI的建议99%正确,那1%的错误如果导致事故,签字人仍将承担刑事责任。这种不对称的风险收益比,让技术先进性在签字权面前显得苍白。

从"工具提供者"到"决策参与者"的角色重构

大多数企业部署AI Agent时,潜意识里仍将其定位为"高级计算器"——输入数据,输出建议,人类负责执行。这种工具化思维在制造业正面临根本性挑战。

我们观察到,成功突破11%采纳率瓶颈的企业,都在重构"人机共责协议"(Human-AI Accountability Protocol)。某特种材料企业在引入Agno v1.4时,没有直接让AI生成"建议值",而是让AI扮演"第二工艺员"角色:它必须像人类工艺员一样,在DCS系统中先提交"模拟申请",在数字孪生环境中验证建议可行性,并生成完整的验证报告。

auto_awesome人机共责协议的三重架构

验证责任共担:AI负责提供数据支撑与模拟结果,人类负责工艺逻辑校验,双方共同承担"验证过程"的文档化责任

决策权分级让渡:对于低风险参数(如冷却水流量微调),AI获得直接调整权;中风险参数(如反应温度)需人工快速确认;高风险参数(如压力阈值)仅提供趋势预警,不生成具体数值建议

审计友好设计:基于Agno v1.4的透明化架构,每条建议必须包含"决策依据溯源"、"置信度评估"、"反事实情景分析"三部分,满足化工行业ISO 9001与安全生产标准化的双重审计要求

这种重构改变了AI的角色定位。当AI不再只是"给出1.8这个数值",而是展示"在12次历史相似工况中,调整至1.8-2.0区间能耗降低10-15%,且无异常工况记录;当前催化剂活性为初始的89%,处于安全调整窗口期内",车间主任的签字意愿显著提升——因为这不是在盲信算法,而是在基于结构化数据做出专业判断。

MCP v2之后的下一个战场:责任基础设施

MCP协议升级到v2版本后,已经支持双向安全上下文传递(Bidirectional Security Context)和细粒度权限控制,理论上可以实现"AI建议-人工审批-自动执行-责任追溯"的闭环。但技术能力的具备不等于组织制度的就绪。

CrewAI v0.120在Process Layer中引入的"决策置信度分级"功能,实际上提供了一个责任界定的技术基础:当置信度>0.95时,AI承担主要验证责任;0.8-0.95区间,人机共担;<0.8时,AI仅提供参考,人类承担完全决策责任。这种技术化的责任边界划分,正在一些先锋企业中被转化为内部管理制度。

但更深层的挑战在于组织心理学层面的"控制感丧失恐惧"。车间主任们抗拒的不是AI本身,而是"被架空"的焦虑。FluxWise智流科技在协助某氟化工集团落地时,采用了一种"渐进式授权"策略:前三个月,AI仅作为"数据整理员",将DCS、MES的多源数据整合为工艺日报,不生成任何建议;第四至六个月,AI开始提供"历史相似工况对比",但不给出具体操作建议;第六个月后,才逐步开放低风险参数的优化建议权限。这种"温水煮青蛙"式的组织变革,让该集团的采纳率在九个月内从11%提升至67%。

回到那800万元损失的节能收益,问题从来不是算法不够聪明,而是组织还没准备好接受算法的聪明。在化工这种高风险、强监管、终身追责的行业,AI Agent的落地最后比拼的不再是技术集成能力,而是制度设计的智慧——如何在释放AI效率的同时,给人类决策者留足"专业尊严"与"安全边界"。这或许比打通任何API都要困难,但也正是制造业智能化真正的分水岭。