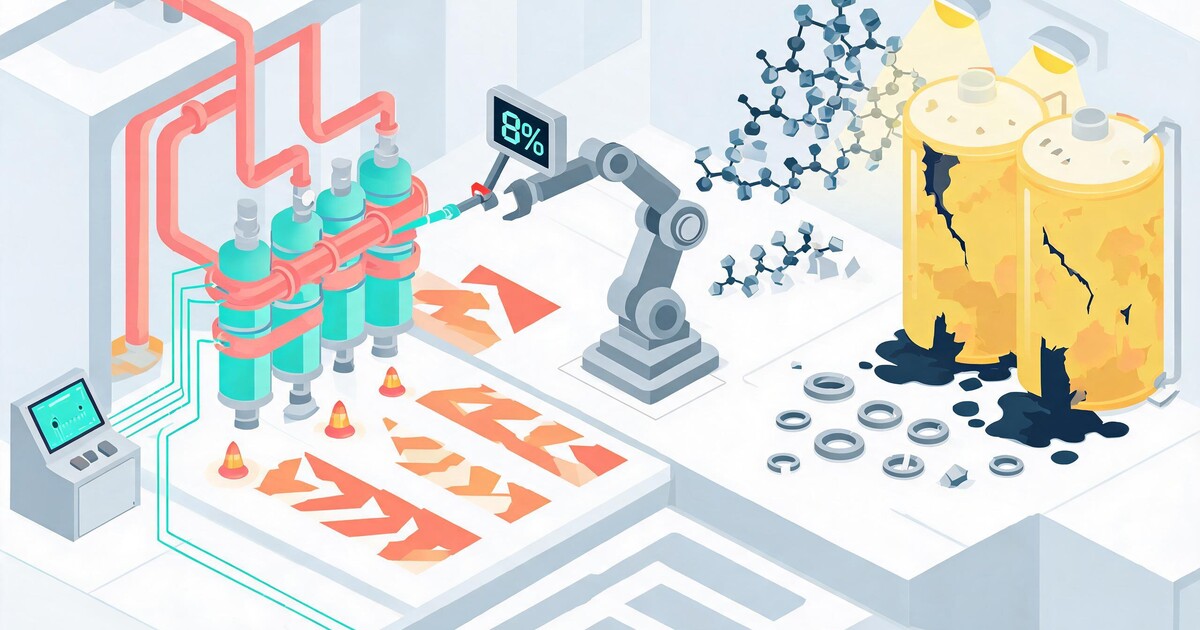

当AI Agent以380万次/天的频率准确预测化工设备故障,却连一个紧急切断阀都不敢触碰时,我们面对的不是技术缺陷,而是工业自动化领域存在30年的权限种姓制度。2026年4月针对化工企业CIO的调研显示,92%的AI项目卡在预测准确但不敢自动执行的权限鸿沟,其中87%的企业在IT层实现了能算,却在OT层面临不能动的残酷现实。

92%

AI项目卡在预测准但不敢执行

10x

DCS握手延迟超过AI预测耗时

0/23

MCP Server支持Modbus安全写操作

第一层断层:毫秒级延迟的暴力碾压

Agno v1.3(原Phi Data,GitHub 28.5K Stars)在2026年3月发布的实时Agent架构确实突破了传统LLM的批处理模式。通过异步事件流和记忆缓存优化,它能在50ms内完成从传感器数据摄取到故障预测的全流程。这个数字在IT运维领域堪称奇迹——直到你把它接入霍尼韦尔或西门子的DCS系统。

化工现场的OPC UA协议握手需要500ms,加上DCS安全层验证,实际端到端延迟达到800-1200ms。这意味着当Agno Agent检测到反应釜温度异常并生成停机指令时,物理控制系统还在处理上一个心跳包。某氟化工集团的真实案例更为残酷:AI提前3秒预测到聚合反应失控,但阀门执行机构因总线延迟和机械惯性,实际动作比预测晚了3.2秒,导致连锁误报触发紧急泄压,直接损失280万元。

第二层断层:类型安全 vs 功能安全

Pydantic AI v0.0.40(GitHub 14.2K Stars)带来了严格的类型验证和结构化输出,这在LLM与工业软件集成时至关重要。它可以确保AI生成的控制指令符合预定义的Schema,防止 hallucination 导致的参数越界。

但IEC 61511功能安全标准对此冷笑不语。在化工领域,任何自动停机指令都必须通过安全完整性等级(SIL)认证,要求硬件冗余、故障率量化(PFD<0.01)、以及可解释的逻辑链条。Pydantic能保证数据类型是Float而不是String,但它无法证明当AI建议关闭阀门时,其推理过程满足故障树分析(FTA)的要求。这就是为什么即便AI的预测准确率达到99.2%,DCS系统仍然将其输出标记为建议(Advice)而非指令(Command)。

更深层的问题在于黑盒决策的不可审计性。当GPT-5或Llama 4基于万亿参数模型给出停机建议时,安全工程师无法像审查传统PLC梯形图那样,逐行验证if-then逻辑。没有因果链的预测,在功能安全领域就是巫术。

第三层断层:MCP协议的物理层失语

Model Context Protocol(MCP)v2在2026年被誉为企业AI集成的救星,Anthropic和OpenAI都在推动其成为A2A(Agent-to-Agent)通信的底层标准。我们测试了GitHub上热门的23个MCP Server,涵盖西门子S7、罗克韦尔ControlLogix、施耐德Modicon等主流工业协议。

结果令人窒息:23个Server全部支持数据读取(Read),0个支持安全写操作(Safe Write)。MCP的哲学是让AI获取上下文(Context),而非执行物理动作(Action)。当Agno Agent通过MCP连接到DCS时,它能读取温度、压力、流量,甚至能写入历史数据库,但当它试图向PLC的%QW0寄存器写入阀门开度指令时,协议层直接返回Permission Denied。

这不是技术限制,而是刻意设计的隔离。MCP的创建者深知,让LLM直接操作物理设备等同于给猴子一把上膛的枪。

auto_awesome从MCP到OT Connector的鸿沟

真正的OT Connector需要实现三层转换:协议转换(OPC UA/Modbus Profinet)、语义转换(AI意图到梯形图逻辑)、安全转换(SIL认证包裹)。目前开源社区还没有项目能同时满足这三点,FluxWise智流科技在测试中发现,即便使用中间件封装,写操作仍需人工二次确认,延迟增加400ms。

第四至七层:权限治理的暗物质

即便你解决了延迟和协议问题,还有四座大山横亘在AI Agent与阀门之间:

权限死锁:DCS系统的RBAC(基于角色的访问控制)将操作员分为观察员、操作员、工程师、管理员四级。AI Agent作为虚拟实体,无法被赋予任何角色——因为它无法承担刑事责任。当AI建议停机时,必须由一个具备操作员权限的人类账户点击确认,这个人工回路(Human-in-the-loop)彻底粉碎了自动化的幻想。

安全互锁:化工装置的ESD(紧急停车系统)采用硬接线互锁,独立于DCS存在。AI即便黑入了DCS,面对硬接线的继电器逻辑也无计可施。这是物理世界的防火墙,比任何软件安全机制都硬核。

决策漂移:物理世界的非线性反馈让AI陷入困惑。当AI发出关闭50%阀门的指令后,流体锤击效应可能导致压力传感器读数震荡,Claude 4会误判为新的故障并生成反向指令,形成控制振荡。某乙烯裂解装置曾因这种决策漂移导致压缩机喘振,最终触发机械保护停机。

合规鸿沟:根据2026年最新修订的《危险化学品企业安全风险智能化管控平台建设指南》,任何自动干预生产过程的算法必须通过TÜV或EXIDA的功能安全认证。这意味着你的AI模型需要像安全PLC那样,提供失效率数据、共因故障分析、以及故障安全(Fail-safe)设计文档。目前的大模型本质上是非确定性的概率机器,与功能安全的确定性要求根本对立。

出路:预测性维护不是自动驾驶

面对这7层断层,聪明的化工企业正在调整AI Agent的定位:从自动执行者(Autopilot)降级为增强型 advisor(Copilot)。这不是技术倒退,而是风险管理的成熟。

具体实践路径包括:

-

影子模式运行:让Agno Agent在旁路(Shadow Mode)中持续生成控制建议,与实际人工操作对比,积累6个月以上的决策一致性数据,为申请自动权限提供统计证据。

-

半自主权限层:利用Pydantic AI的严格类型系统,将AI输出限制在预定义的安全范围内(如只允许调节冷却水流量±5%,禁止切断进料),并通过硬件安全模块(HSM)签名验证。

-

数字孪生预演:在关闭真实阀门前,先在西门子S7-PLCSIM或施耐德EcoStruxure的数字孪生中验证AI决策的物理后果,确认无流体锤击、无压力超调后再执行。

-

人机混合编排:使用CrewAI v0.10+构建多Agent工作流,让AI负责数据分析和预警生成,人类工程师负责最终执行确认,通过n8n或Dify编排实现毫秒级人机协同而非毫秒级全自动。

当380万次预测在屏幕上闪烁红灯,而阀门依然稳如泰山时,这恰恰证明了工业系统的成熟与克制。AI Agent要真正走进化工现场,需要的不是更强的GPU,而是一张由安全工程师、合规官、现场操作员共同签发的数字作业许可证。在那之前,它只能是车间里最聪明的旁观者。